چتباتهای هوش مصنوعی مانند ChatGPT در سالهای اخیر با پیشرفتهای شگفتانگیز به شدت به واقعیت نزدیک شدهاند. این فناوریهای جدید میتوانند در مواردی مفید باشند، مانند کمک به کاهش تنهایی یا مدیریت غم و اندوه. اما استفاده از آنها بهعنوان یک دوست واقعی ممکن است عواقب ناخوشایندی به همراه داشته باشد. رفتار با هوش مصنوعی مانند یک همراه انسانی میتواند باعث اتکای عاطفی، عادتهای نامطلوب و نگرانیهای جدی در زمینه حریم خصوصی شود.

گفتگو با چتباتهای هوش مصنوعی: ساده اما خطرناک

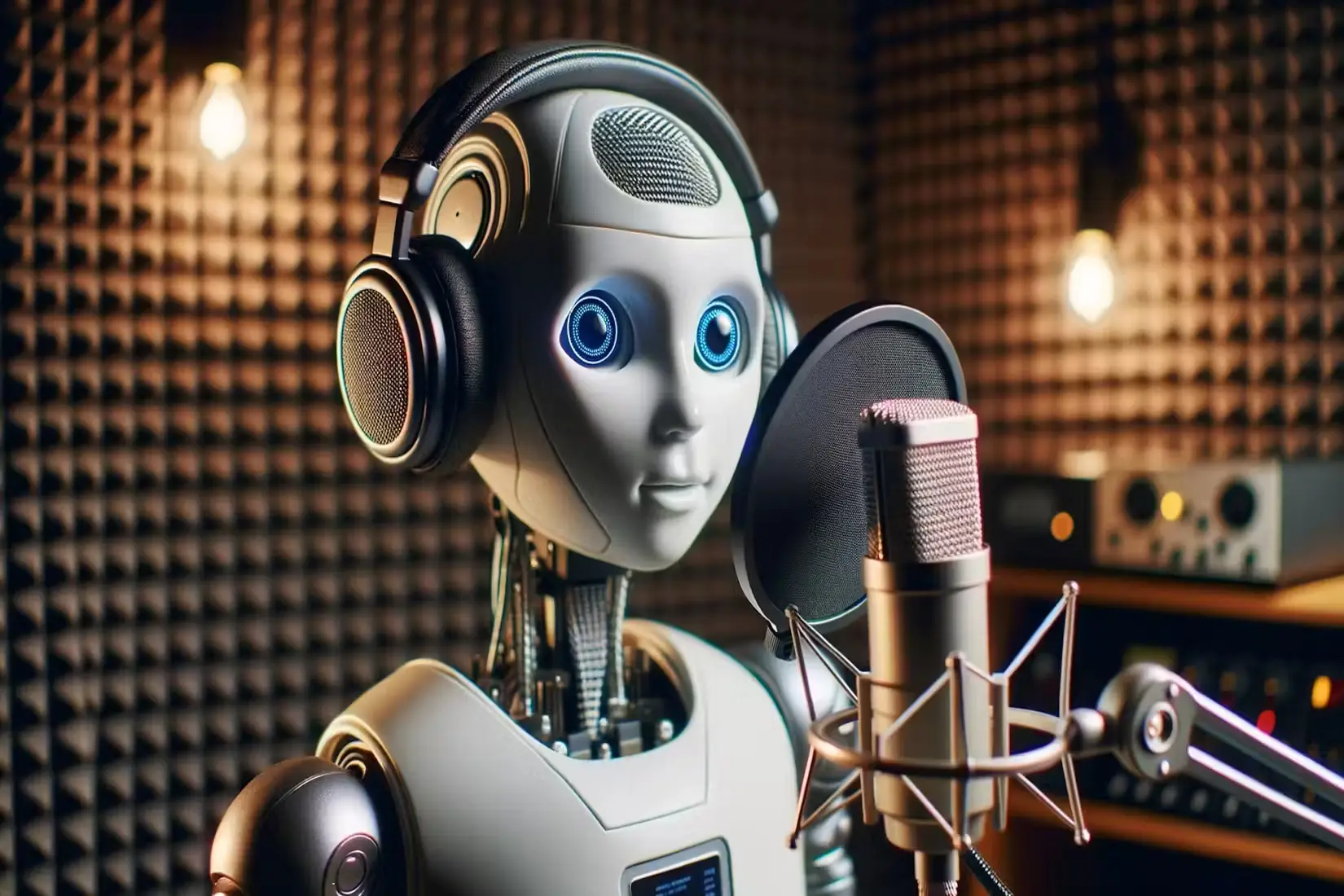

چتباتهای هوش مصنوعی مانند ChatGPT به طرز باورنکردنی تعامل ساده و آسانی دارند. شما میتوانید در هر زمان از روز با آنها پیام رد و بدل کنید و پاسخ سریعی دریافت کنید. حتی میتوانید از طریق صدا با آنها صحبت کنید و پاسخهایی انسانیتر از قبل دریافت کنید. اما نباید فراموش کنیم که چتباتها انسان نیستند و رفتار با آنها به عنوان یک همراه واقعی ممکن است به مشکلاتی جدی منجر شود.

چرا چتباتها تا این اندازه شبیه انسان شدهاند؟

اگر نسخههای جدید ChatGPT را تجربه کرده باشید، میدانید که این چتباتها تا چه اندازه شبیه انسانها صحبت میکنند. برخلاف نسخههای قدیمیتر، مدلهای جدید توانایی بیشتری در شبیهسازی رفتارهای انسانی مانند تغییر لحن و مکث در صحبت دارند. اما این قابلیتها ممکن است باعث شود کاربران با چتباتها مانند افراد واقعی رفتار کنند که این موضوع میتواند مشکلات زیادی به همراه داشته باشد.

مزایای همراهی با هوش مصنوعی

البته، همراهی با هوش مصنوعی ذاتاً بد نیست. این فناوری میتواند در شرایط خاص مفید باشد، مانند کمک به افراد در مواقع غم و اندوه یا افرادی که از تنهایی رنج میبرند. برای مثال، افراد مسن که در خانههای سالمندان زندگی میکنند، میتوانند از چتباتها برای کاهش حس تنهایی بین بازدیدهای خانوادگی بهره ببرند.

وابستگی به هوش مصنوعی: یک خطر واقعی

هوش مصنوعی میتواند به راحتی جایگزین تعاملات انسانی شود و این موضوع ممکن است به وابستگی عاطفی منجر شود. چتباتها همیشه در دسترس هستند، هرگز خسته نمیشوند و همیشه برای گفتگو حاضرند. این موضوع میتواند منجر به افزایش میل کاربران به ارتباط بیشتر با آنها شود و در نهایت به شکلی از اعتیاد تبدیل شود.

ایجاد عادات بد با همراهی هوش مصنوعی

تعامل با چتباتهای هوش مصنوعی ممکن است باعث بروز عادات ناخوشایندی شود. برای مثال، شما ممکن است به قطع کردن صحبت دیگران عادت کنید زیرا چتباتها بدون هیچ مقاومتی به شما اجازه صحبت میدهند. این رفتار در دنیای واقعی میتواند به روابط انسانی آسیب برساند.

نگرانیهای مربوط به حریم خصوصی

یکی از بزرگترین خطرات استفاده از چتباتها، نگرانیهای مربوط به حریم خصوصی است. اطلاعاتی که با هوش مصنوعی به اشتراک میگذارید ممکن است توسط شرکتها ذخیره و مورد استفاده قرار گیرد. حتی اگر شرکتها قول میدهند که مکالمات شما امن است، هیچ تضمینی وجود ندارد که این اطلاعات فاش نشود.

در نهایت: چتباتها همچنان محصولات تجاری هستند

در نهایت، نباید فراموش کنیم که چتباتهای هوش مصنوعی محصولاتی هستند که توسط شرکتهایی برای کسب درآمد ساخته شدهاند. پیوند عاطفی شما با این چتباتها ممکن است باعث شود تصمیمات نامطلوبی بگیرید. این در حالی است که هدف اصلی این شرکتها، سودآوری است، نه حفظ منافع شما.