وقتی به مدلهای زبان در رابطه با هوش مصنوعی مولد (AI) فکر میکنید، اولین اصطلاحی که احتمالاً به ذهن میرسد زبان بزرگ است. مدل (LLM). این LLM ها محبوب ترین ربات های چت مانند ChatGPT، Bard و کپیلوت. با این حال، مدل زبان جدید مایکروسافت اینجاست تا نشان دهد که مدلهای زبان کوچک (SLM) در فضای هوش مصنوعی نیز نویدهای بزرگی دارند.

در روز چهارشنبه، مایکروسافت رونمایی کرد Phi-2، یک مدل زبان کوچک که قادر به استدلال عقل سلیم و درک زبان است، و’ اکنون در کاتالوگ مدل Azure AI Studio موجود است.

همچنین: هوش مصنوعی در سال 2023: سالی از پیشرفت هایی که هیچ چیز انسانی را بدون تغییر باقی نگذاشت

با این حال، اجازه ندهید کلمه کوچک شما را گول بزند. Phi-2 دارای 2.7 میلیارد پارامتر در مدل خود است که یک جهش بزرگ از Phi-1.5 است که 1.3 میلیارد پارامتر داشت.

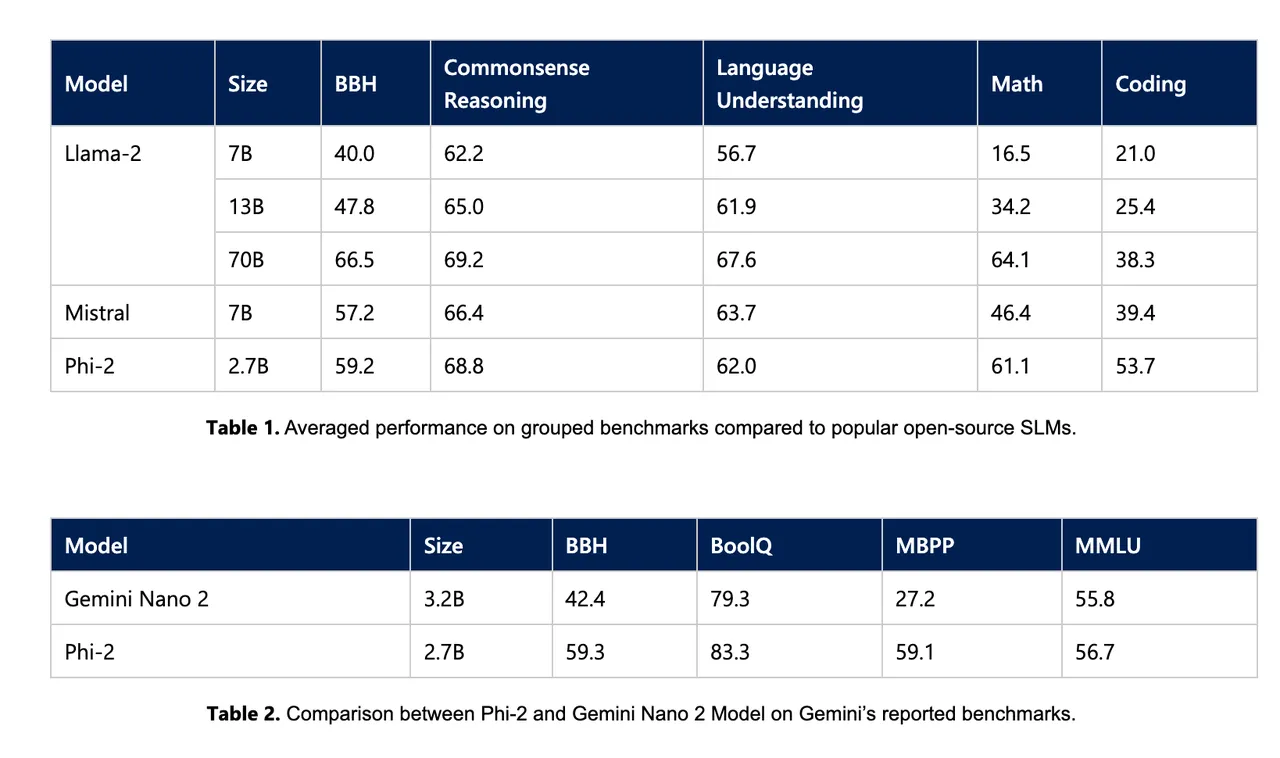

با وجود جمع و جور بودن، Phi-2 “عملکرد پیشرفته” را به نمایش گذاشت. به گفته مایکروسافت، در میان مدلهای زبانی با کمتر از 13 میلیارد پارامتر، و حتی از مدلهای تا 25 برابر بزرگتر در معیارهای پیچیده بهتر عمل کرد.

همچنین: دو پیشرفت، نوآورانهترین سال فناوری در بیش از یک دهه گذشته در سال 2023 بوده است

Phi-2 عملکرد بهتری از مدلها داشت از جمله Meta’s Llama-2، Mistral، و حتی Google Gemini Nano 2، که کوچکترین نسخه از توانمندترین LLM گوگل، Gemini است – در چندین معیار مختلف، همانطور که در زیر مشاهده می کنید.

نتایج عملکرد Phi-2 با هدف مایکروسافت با Phi برای توسعه یک SLM با قابلیتهای نوظهور و عملکرد قابل مقایسه با مدلهای در مقیاس بسیار بزرگتر مطابقت دارد.

همچنین: ChatGPT در مقابل Bing Chat در مقابل Google Bard: بهترین چت ربات هوش مصنوعی کدام است؟

یک سوال باقی می ماند که آیا می توان چنین توانایی های نوظهوری را در مقیاس کوچکتر با استفاده از انتخاب های استراتژیک برای آموزش، به عنوان مثال، انتخاب داده ها به دست آورد یا خیر. مایکروسافت گفت.

خط کار ما با مدلهای Phi با آموزش SLMهایی که عملکردی همتراز با مدلهای مقیاس بزرگتر دارند (اما هنوز با مدلهای مرزی فاصله دارند) به این سوال پاسخ میدهد.

هنگام آموزش Phi-2، مایکروسافت در مورد داده های مورد استفاده بسیار گزینشگر بود. این شرکت ابتدا از چیزی که آن را کیفیت کتاب درسی می نامد استفاده کرد. داده ها. سپس مایکروسافت پایگاه داده مدل زبان را با افزودن دادههای وب با دقت انتخاب شده، که بر اساس ارزش آموزشی و کیفیت محتوا فیلتر شده بود، تقویت کرد.

بنابراین، چرا مایکروسافت بر روی SLM متمرکز شده است؟

همچنین: این 5 پیشرفت بزرگ فناوری در سال 2023 بزرگترین تغییر دهنده بازی بودند

SLM ها یک جایگزین مقرون به صرفه برای LLM هستند. مدلهای کوچکتر همچنین زمانی مفید هستند که برای کارهایی استفاده میشوند که به اندازه کافی برای نیاز به قدرت یک LLM نیاز ندارند.

علاوه بر این، توان محاسباتی مورد نیاز برای اجرای SLMها بسیار کمتر از LLMها است. این کاهش نیاز به این معنی است که کاربران لزوماً مجبور نیستند برای تامین نیازهای پردازش داده خود، روی GPU های گران قیمت سرمایه گذاری کنند.