OpenAI یک ابزار خزنده وب به نام “GPTBot” را معرفی کرده است که هدف آن تقویت قابلیت های مدل های آینده GPT است.

این شرکت میگوید دادههای جمعآوریشده از طریق GPTBot به طور بالقوه میتواند دقت مدل را افزایش داده و قابلیتهای آن را گسترش دهد و گام مهمی در تکامل مدلهای زبان مبتنی بر هوش مصنوعی باشد.

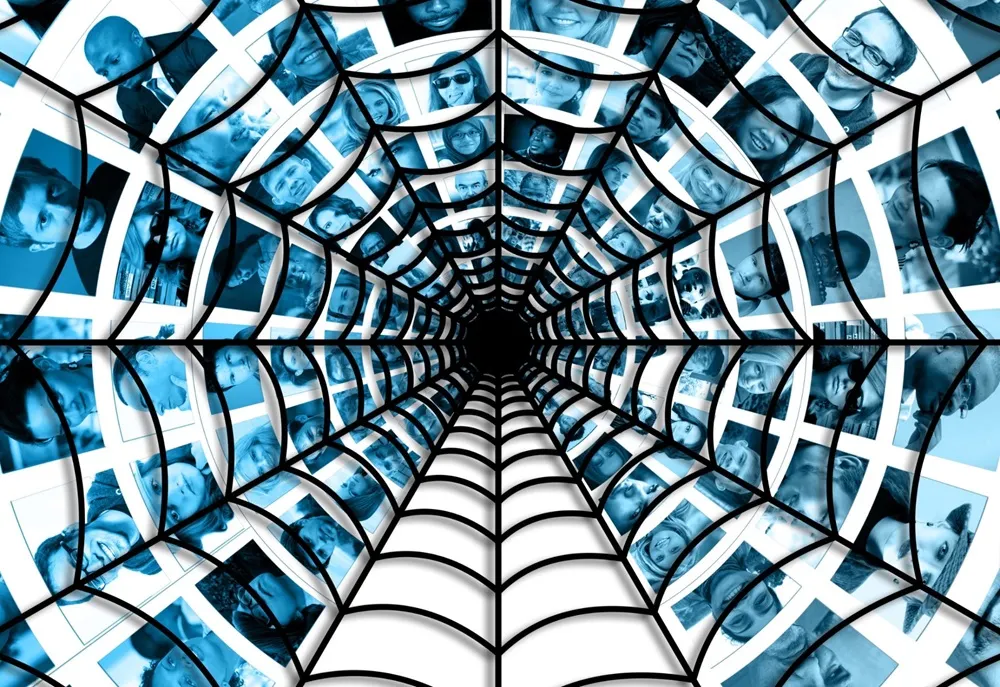

خزنده های وب – که به آنها عنکبوت های وب نیز گفته می شود – نقشی اساسی در نمایه سازی محتوا در گستره وسیع اینترنت دارند. موتورهای جستجوی معروفی مانند گوگل و بینگ برای پر کردن نتایج جستجوی خود با صفحات وب مرتبط به این ربات ها متکی هستند.

GPTBot OpenAI هدف مشخصی خواهد داشت: جمعآوری دادههای در دسترس عموم و در عین حال دور زدن منابعی که شامل دیوارهای پرداخت، جمعآوری دادههای شخصی یا محتوایی است که با خطمشیهای OpenAI مغایرت دارد.

صاحبان وبسایتها میتوانند از خزیدن GPTBot در سایتهایشان به سادگی با اجرای دستور «عدم اجازه» در یک فایل سرور استاندارد جلوگیری کنند. این امر به آنها اجازه می دهد تا کنترل کنند که کدام بخش از محتوای آنها برای خزنده وب قابل دسترسی است.

اعلامیه OpenAI دقیقاً پس از ارائه درخواست علامت تجاری توسط این شرکت برای “GPT-5” دنبال میشود که پیشبینی میشود جایگزین مدل فعلی GPT-4 شود.

این پرونده که در 18 ژوئیه در اداره ثبت اختراع و علائم تجاری ایالات متحده انجام شد، شامل استفاده از “GPT-5” در گفتار و متن انسان مبتنی بر هوش مصنوعی، تبدیل صدا به متن، تشخیص صدا و ترکیب گفتار است.

با این حال، در حالی که برنامه علامت تجاری GPT-5 باعث ایجاد هیجان در بین علاقه مندان به هوش مصنوعی شده است، سم آلتمن، مدیر عامل OpenAI نسبت به انتظارات زودهنگام هشدار داد. آلتمن فاش کرد که این شرکت هنوز تا شروع آموزش GPT-5 فاصله دارد، زیرا باید قبل از شروع این فرآیند، ممیزی های ایمنی گسترده ای انجام شود.

تلاشهای اخیر OpenAI بدون بحث و جدل نبوده است. نگرانیهایی در مورد شیوههای جمعآوری دادههای شرکت، بهویژه مسائل مربوط به کپی رایت و رضایت ایجاد شده است.

در ژوئن، رگولاتور حریم خصوصی ژاپن هشداری به OpenAI درباره جمعآوری غیرمجاز دادهها صادر کرد. در اوایل سال جاری، ایتالیا استفاده از ChatGPT را به دلیل نقض قوانین حریم خصوصی اتحادیه اروپا به طور موقت ممنوع کرد.

OpenAI و مایکروسافت در حال حاضر با یک شکایت دسته جمعی توسط 16 شاکی که ادعا می کنند به اطلاعات خصوصی از تعاملات کاربر ChatGPT بدون رضایت مناسب دسترسی پیدا کرده اند، روبرو هستند. این شرکتها همچنین با شکایتی بر سر GitHub Copilot شکایت کردهاند و مدعیان ادعا میکنند که ابزار تولید کد با حذف کد آنها بدون ارائه انتساب مناسب، حقوق توسعهدهندگان را نقض کرده است.

اگر این ادعاها صحت داشته باشند، OpenAI و مایکروسافت به طور بالقوه می توانند قانون کلاهبرداری و سوء استفاده رایانه ای را نقض کنند، یک سابقه قانونی در ارتباط با پرونده های خراش دادن وب.

همانطور که OpenAI به پیشبرد مرزهای فناوری هوش مصنوعی ادامه می دهد، باید این چالش ها را برای اطمینان از توسعه مسئولانه و اخلاقی در چشم انداز هوش مصنوعی بررسی کند.